Για την εκπαίδευσή του, το ChatGPT διάβασε 300 δισ. λέξεις περίπου. Για να φτάσει αυτές τις επιδόσεις ένας άνθρωπος, θα χρειαζόταν να διαβάζει ένα βιβλίο 240 σελίδων τη μέρα για 14.000 χρόνια! Με τόσο διάβασμα που έριξε το ChatGPT, θα περιμέναμε κάτι καλύτερο…

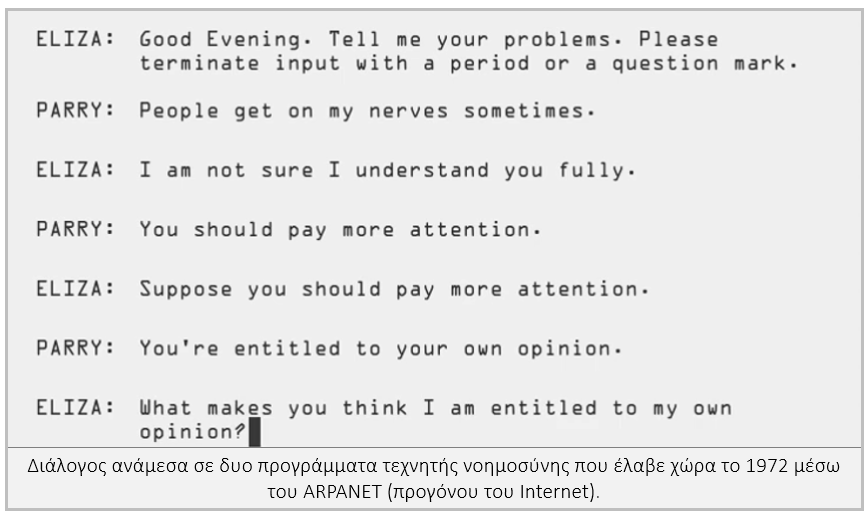

«Οι μηχανές είναι φτιαγμένες για να συμπεριφέρονται με θαυμαστούς τρόπους, συχνά επαρκείς για να θαμπώνουν ακόμα και τον πιο έμπειρο παρατηρητή. Αλλά μόλις εξηγηθούν οι εσωτερικές τους λειτουργίες, η μαγεία τους καταρρέει. Αποκαλύπτονται ως μια απλή συλλογή διαδικασιών», σημείωνε το μακρινό 1966 ο Weizenbaum, Joseph, αναφερόμενος στον αντίκτυπο του ELIZA, του πρώτου Chatbot[1] της ιστορίας, που είχε σχεδιάσει ο ίδιος.

Από τότε, εμφανίστηκαν αρκετοί προφήτες για να αναγγείλουν την επερχόμενη έλευση της γενικής τεχνητής νοημοσύνης. «Σε τρία έως οκτώ χρόνια θα έχουμε μια μηχανή με τη γενική νοημοσύνη ενός μέσου ανθρώπου», δήλωνε με βεβαιότητα ο Marvin Minsky το 1970, στο Life Magazine.

Εις μάτην! Οι φιλοδοξίες για τη δημιουργία ευφυών μηχανών που θα άλλαζαν τη ζωή μας έχουν αποτύχει επανειλημμένα. Η IBM, για να σταθούμε στο πιο πρόσφατο παρελθόν, κατέληξε σε ένα πιο ταπεινό όραμα για τον Watson, ενώ οι ψηφιακοί βοηθοί των Big Tech (Apple - Siri, Amazon - Alexa, Google - Google Assistant, Microsoft - Cortana) έχασαν το στοίχημα των δημιουργών τους και έδωσαν τροφή για γέλιο.

Αυτά μέχρι το τέλος του περασμένου φθινοπώρου.

Πριν μας αποχαιρετήσει ο Νοέμβρης, έφερε στο προσκήνιο ένα «θαύμα της μηχανικής μάθησης». Το ChatGPT. Μια μηχανή που δίνει απαντήσεις, παίρνει πτυχία, προκαλεί, απολογείται, ερωτεύεται, κοροϊδεύει, γράφει κατά παραγγελία κώδικα ή ποιήματα, λέει ψέματα, γεννάει ελπίδες και φόβους, όπως κάθε «επαναστατική» τεχνολογία που σέβεται τον εαυτό της.

Πού βρίσκεται όμως η αλήθεια για τις δυνατότητες της τεχνητής νοημοσύνης σήμερα; Μπορούμε να μιλάμε για νοημοσύνη, όταν αναφερόμαστε σε αυτές τις μηχανές;

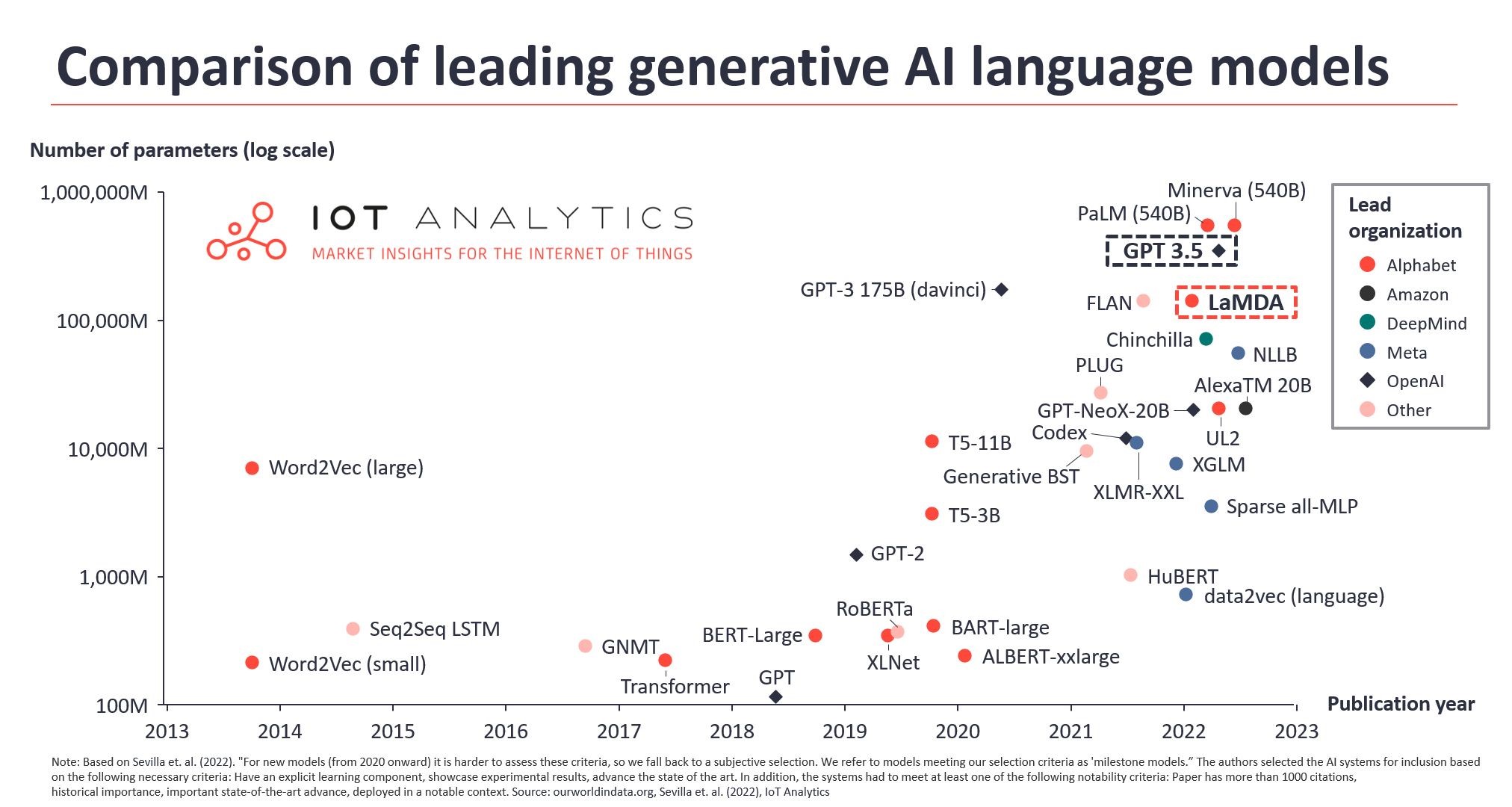

Τα τελευταία χρόνια, η τεχνητή νοημοσύνη έχει γνωρίσει εκρηκτική ανάπτυξη.

Όπως αποδεικνύεται όμως, από εμπειρικές παρατηρήσεις και επιστημονικές μελέτες, τόσο το GPT-3 με το νεότερο αδερφάκι του GPT-4, όσο και τα αντίστοιχα προγράμματα των άλλων κατασκευαστών, απέχουν πολύ από το να θεωρηθούν νοήμονα. Στον βαθμό που με αυτό τον όρο περιγράφουμε την ιδιαίτερη ικανότητα του ανθρώπου όχι μόνο να θυμάται, να προσαρμόζεται ή να αντιγράφει, αλλά να αντιλαμβάνεται, να εξηγεί, να φαντάζεται και να επινοεί πρωτότυπες ιδέες.

Το «λειτουργικό σύστημα» του εγκεφάλου μας προικίζει τους ανθρώπους με την ικανότητα να εγκαθιστούν διαρκώς νέα προγράμματα που αξιοποιούν τις γνώσεις και τη σοφία του πολιτισμού μας, δημιουργούν σύνθετες προτάσεις και αλυσιδωτές διαδρομές σκέψης, δοκιμάζουν, διορθώνουν, προχωράνε.

Αυτά τα προγράμματα «έχουν μείνει κολλημένα σε μια προανθρώπινη φάση της γνωστικής εξέλιξης. Το βαθύτερο ελάττωμά τους είναι η απουσία της πιο κρίσιμης ικανότητας οποιασδήποτε νοημοσύνης: να λένε όχι μόνο τι συμβαίνει, τι συνέβη και τι θα συμβεί -αυτό είναι περιγραφή και πρόβλεψη- αλλά και τι δεν συμβαίνει και τι θα μπορούσε και δεν θα μπορούσε να συμβεί. Αυτά είναι τα συστατικά της εξήγησης, το αποτύπωμα της αληθινής νοημοσύνης», σημείωνε πρόσφατα ο Noam Chomsky.

Το ChatGPT «έχει παραισθήσεις και μπορεί να δημιουργήσει απαντήσεις που είναι φαινομενικά πειστικές, αλλά στην πραγματικότητα είναι λάθος» παρατήρησαν αναλυτές της Morgan Stanley, τον περασμένο μήνα.

«Yπάρχει ένα χάσμα μεταξύ των ανθρώπων και αυτών των αλγορίθμων… H γλωσσική τους κατανόηση είναι επιφανειακή… Ενώ τα γλωσσικά μοντέλα είναι προγραμματισμένα να προβλέπουν κοντινές λέξεις, ο ανθρώπινος εγκέφαλος προβλέπει συνεχώς μια ιεραρχία αναπαραστάσεων που εκτείνονται σε πολλαπλές χρονικές κλίμακες», διαπιστώνει μελέτη που συνέκρινε τη λειτουργία του ανθρώπινου εγκεφάλου με εκείνη των μηχανών και δημοσιεύτηκε τις αρχές Μαρτίου στο Nature.

Οι μηχανές αυτές αξιοποιούν την επεξεργαστική ισχύ των σύγχρονων υπολογιστών, τους απίστευτους σωρούς δεδομένων που στοιβάζονται καθημερινά και τα κεφάλαια που επενδύονται αφειδώς για να υπολογίζουν πιθανότητες. Αναμασούν απίστευτο όγκο πληροφοριών, ώστε να διατυπώνουν απαντήσεις που προσπαθούν να μιμηθούν τις επιθυμίες των χρηστών τους. «Ό,τι κι αν ψάχνετε -ό,τι επιθυμείτε- θα το προσφέρουν» σημειώνει ο Δρ Terrence Sejnowski.

Τα πρόσφατα επιτεύγματα, της μηχανικής μάθησης όπως το ChatGPT, αν και δεν σκέφτονται «συνειδητά», με τον τρόπο δηλαδή που το κάνει ένας άνθρωπος, ούτε «κατανοούν» όσα λένε, είναι ικανά χάρη στο μέγεθος της πληροφορίας που έχουν «συμπεριλάβει», να αναγνωρίζουν ερωτήσεις και να απαντάνε με τρόπο που δείχνει νοημοσύνη.

Πρόκειται για μια επαναστατική εξέλιξη και ως τέτοια δεν δημιουργεί απλώς νέα εργαλεία. Διαμορφώνει και ένα νέο τρόπο αντίληψης, που θέτει επί τάπητος κομβικά ερωτήματα για το παρόν και το μέλλον του είδους μας και του πολιτισμού του.

Με τους αλγόριθμους, ο Homo Sapiens ανέπτυξε ένα εργαλείο αντάξιο των προσδοκιών του. Ένα εργαλείο που φέρεται να κρατάει το κλειδί για το πέρασμα από το βασίλειο της αναγκαιότητας στο βασίλειο της ελευθερίας. Τη δημιουργία δηλαδή ενός καλύτερου κόσμου, όπου οι άνθρωποι θα απαλλαγούν από το άγχος των βιοτικών αναγκών τους και θα έχουν άπλετο χρόνο για συζήτηση, έρωτα, παιχνίδι, τέχνη, διασκέδαση... Έναν κόσμο ελευθερίας και δικαιοσύνης.

Ο «παροξυσμός αισιοδοξίας» για την Τεχνητή Νοημοσύνη συνοδεύεται όμως και από έντονους προβληματισμούς για τους όρους, τα όρια και τις επιπτώσεις της ανάθεσης ανθρώπινων δραστηριοτήτων σε τέτοια συστήματα. Οι επιφυλάξεις ενισχύονται από την αδιαφάνεια και την αδυναμία κατανόησης αυτών των συστημάτων που χαρακτηρίζονται από αυτονομία. Οι πιθανές αρνητικές επιπτώσεις επιτείνονται, εξαιτίας της μεγάλης ασυμμετρίας ισχύος μεταξύ εκείνων που αναπτύσσουν και εφαρμόζουν αλγοριθμικά συστήματα και των χρηστών ή όσων υφίστανται τα αποτελέσματα αυτών των συστημάτων. Η εναπόθεση των κανόνων ανάπτυξης της τεχνητής νοημοσύνης στις Big Tech είναι καλή είδηση για τις ίδιες, όχι όμως για την κοινωνία. Αν η γραφίδα αποδείχτηκε πιο αποτελεσματική για τον έλεγχο του πληθυσμού από το ξίφος, ο έλεγχος της τεχνητής νοημοσύνης μπορεί να αποβεί τυραννικός για την ατομική ελευθερία αλλά και το είδος μας.

Είμαστε στην αυγή μιας νέας εποχής. Από τις δράσεις μας θα κριθεί όχι μόνο το μέλλον του πολιτισμού μας αλλά και η θέση του είδους μας. Η αξιοποίηση των εκπαιδευτικών συστημάτων για την καθολική εκμάθηση - υιοθέτηση των ψηφιακών τεχνολογιών, την εμβάθυνση της κριτικής σκέψης και την επαναφορά του ανθρωπισμού στο επίκεντρο του ενδιαφέροντος αποτελεί αναγκαία προϋπόθεση για το μέλλον του πολιτισμού και του είδους μας. Η διαμόρφωση κανόνων λειτουργίας της τεχνητής νοημοσύνης, που θα εμπνέονται από τα χρώματα της Γαλλικής Επανάστασης, την αναγκαία συνθήκη.

Η επιλογή είναι δική μας!

* O Κ. Χρήστος Παπαδόπουλος είναι διευθύνων σύμβουλος της Witside

[1] Ο όρος Chatbot δεν είχε εφευρεθεί ακόμη.

Oι απόψεις που διατυπώνονται σε ενυπόγραφο άρθρο γνώμης ανήκουν στον συγγραφέα και δεν αντιπροσωπεύουν αναγκαστικά, μερικώς ή στο σύνολο, απόψεις του Euro2day.gr.

Πρασίνισε η έρημος στη Σαουδική Αραβία

Πρασίνισε η έρημος στη Σαουδική Αραβία Μυτιληναίoς: Ετοιμάζω μεγάλη επένδυση για παραγωγή γαλλίου

Μυτιληναίoς: Ετοιμάζω μεγάλη επένδυση για παραγωγή γαλλίου Αποσύρθηκε από την Ερυθρά Θάλασσα το ιρανικό πλοίο «μυστήριο»

Αποσύρθηκε από την Ερυθρά Θάλασσα το ιρανικό πλοίο «μυστήριο» Νέο οικιστικό συγκρότημα στην Αθηναϊκή Ριβιέρα, ξεκινά η κατασκευή του Apollo Hills

Νέο οικιστικό συγκρότημα στην Αθηναϊκή Ριβιέρα, ξεκινά η κατασκευή του Apollo Hills Πότε θα αρχίσουν τα πρόστιμα για μη δημοσιοποίηση στοιχείων στο ΓΕΜΗ

Πότε θα αρχίσουν τα πρόστιμα για μη δημοσιοποίηση στοιχείων στο ΓΕΜΗ Χτύπημα Ισραήλ στο Ιράν, δεν ετοιμάζει άμεσα αντίποινα η Τεχεράνη

Χτύπημα Ισραήλ στο Ιράν, δεν ετοιμάζει άμεσα αντίποινα η Τεχεράνη Η Aegean επενδύει σε τέσσερα νέα Airbus μεγαλύτερης εμβέλειας

Η Aegean επενδύει σε τέσσερα νέα Airbus μεγαλύτερης εμβέλειας Εφορία: Δεκαπέντε πίνακες-φωτιά για όσους αμφισβητήσουν τεκμήρια

Εφορία: Δεκαπέντε πίνακες-φωτιά για όσους αμφισβητήσουν τεκμήρια Δυτικός επενδυτής καταγγέλλει όργιο διαφθοράς στο περιβάλλον Ζελένσκι

Δυτικός επενδυτής καταγγέλλει όργιο διαφθοράς στο περιβάλλον Ζελένσκι Μπαίνουν μπουλντόζες για το νέο γήπεδο του ΠΑΟ στον Βοτανικό

Μπαίνουν μπουλντόζες για το νέο γήπεδο του ΠΑΟ στον Βοτανικό